Dlaczego IoT „istniało”, zanim nazwano je IoT

Internet rzeczy nie narodził się w chwili, gdy ktoś wymyślił modny skrót „IoT”. Przez dziesięciolecia inżynierowie tworzyli systemy, które łączyły czujniki, sterowniki i sieci komunikacyjne – tylko nazywali je inaczej: telemetrią, automatyką, M2M, SCADA, systemami wbudowanymi. Dzisiejsze platformy IoT to raczej zwieńczenie długiej ewolucji niż rewolucja znikąd.

Różnica między modą marketingową a rzeczywistą ewolucją technologii jest kluczowa. Marketing skupia się na hasłach: „smart”, „connected”, „cloud”. Technologie rozwijały się tymczasem liniowo: od pojedynczych czujników, przez lokalną automatykę, hierarchiczne systemy sterowania, po rozproszone sieci urządzeń. Kiedy pojawiły się tanie mikrokontrolery, mobilny Internet i chmura, to, co od dawna istniało w przemyśle, „wylało się” do świata konsumenckiego i dostało nową etykietę – internet rzeczy.

Przykłady „przed-IoT” są wszędzie:

- automatyka kotłowni i węzłów cieplnych monitorowanych zdalnie przez operatora,

- systemy telemetryczne w energetyce, które od lat 70. przesyłały stany wyłączników i wartości prądów na centralne dyspozytornie,

- systemy alarmowe w bankach i sklepach z zasilaniem awaryjnym i zdalnym monitoringiem,

- pagery i radiotelefony w karetkach, kolei czy straży pożarnej, stanowiące zalążek komunikacji M2M,

- pierwsze terminale płatnicze, komunikujące się przez linie telefoniczne i sieci X.25.

Znajomość tej historii daje bardzo praktyczne korzyści. Pozwala rozróżnić, gdzie faktycznie potrzebne są nowe technologie (np. chmura, analityka czasu rzeczywistego), a gdzie wystarczy sprawdzona architektura z PLC i prostą telemetrią. Ułatwia wybór protokołów, topologii sieci i sposobu zabezpieczania systemów. Pozwala też szybciej wychwycić pusty „buzzword bingo” na prezentacjach dostawców i skupić się na konkretnych wymaganiach biznesowych i technicznych.

Kto rozumie, jak kiedyś budowano SCADA, DCS czy systemy M2M, ten dziś dużo świadomiej projektuje smart home, produkcję „Industrie 4.0” czy małe hobbystyczne projekty IoT. Warto tę przewagę świadomie wykorzystać, zamiast ulegać wrażeniu, że wszystko trzeba wymyślać od nowa.

Pierwsze czujniki i automatyzacja: era przekaźników i analogowych systemów

Od regulatora Watta do przekaźnikowych sterowni

Historia internetu rzeczy zaczyna się na długo przed pojawieniem się elektroniki. Jeden z pierwszych „inteligentnych” układów sterowania to regulator odśrodkowy Watta z XIX wieku, używany w maszynach parowych. Obracające się ciężarki działały jak mechaniczny czujnik prędkości: przyspieszenie powodowało ich odchylenie i przymknięcie zaworu pary, spadek prędkości – odwrotnie. To nic innego jak prymitywny, ale bardzo sprytny układ sprzężenia zwrotnego.

Później pojawiły się kolejne mechaniczne i elektromechaniczne „czujniki”: termostaty bimetaliczne, wyłączniki ciśnieniowe, pływakowe sygnalizatory poziomu. Każde z tych urządzeń pełniło rolę lokalnego sensora i aktuatora w jednym – mierzyło wielkość fizyczną i reagowało na nią bez udziału człowieka. W elektrowniach, fabrykach czy na kolei zaczęto masowo używać przekaźników i styczników, które umożliwiały budowę prostych układów logicznych: „jeżeli temperatura > X i ciśnienie < Y, załącz pompę”.

W pierwszej połowie XX wieku powstały ogromne przekaźnikowe szafy sterownicze. Każda zmiana algorytmu sterowania wymagała dosłownego „przeprzewodowania” układu: zmiany połączeń, dodania przekaźników, modyfikacji pól stykowych. W linii produkcyjnej czy elektrowni wymiana logiki mogła trwać dni. Z dzisiejszej perspektywy wygląda to jak horror utrzymaniowy, ale na tle swoich czasów było to ogromne przyspieszenie i automatyzacja procesu.

Analogowe przyrządy pomiarowe – manometry, termometry, przepływomierze, wskaźniki poziomu – dawały operatorom w sterowni wgląd w sytuację. Były to jednak urządzenia lokalne. Dane nie „płynęły” do żadnego serwera – odczytywał je człowiek, notował na papierze, porównywał z normami i podejmował decyzje. Człowiek był więc kluczowym „łącznikiem danych” w tym proto-IoT: to on odbierał sygnał z czujnika i „przesyłał” go dalej, telefonem, radiostacją lub po prostu idąc do przełożonego.

Ograniczenia tej epoki były oczywiste: brak cyfrowości, bardzo ograniczony zasięg (zwykle jedna hala lub budynek), dominacja ręcznych odczytów. Nie istniało jeszcze naturalne pojęcie „sieci czujników” – wszystko było podporządkowane lokalnemu procesowi i lokalnej obsłudze. Mimo to wiele fundamentalnych koncepcji – histereza, redundancja, separacja obwodów bezpieczeństwa – urodziło się właśnie w tych prostych, analogowych systemach.

Narodziny myślenia o systemie, nie o pojedynczym urządzeniu

Kolejny krok był bardziej mentalny niż techniczny: inżynierowie zaczęli patrzeć na całą instalację jako system naczyń połączonych, a nie zbiór niezależnych czujników i styczników. W sterowniach pojawiły się tablice synoptyczne i pierwsze schematy blokowe, które pokazywały zależności między elementami. Zamiast patrzeć na pojedynczy manometr, operatorzy widzieli cały „obraz” procesów i mogli analizować trendy.

Szafy sterownicze stawały się meridianami danych zakładu: setki przewodów wchodziły z czujników rozmieszczonych w hali produkcyjnej, a następnie wychodziły do elementów wykonawczych – zaworów, silników, przysłon. To wymusiło uporządkowanie pojęć: sygnały wejściowe, wyjściowe, sygnały alarmowe, sygnały blokad. Pojawiły się pierwsze standardy oznaczeń i dokumentacji, które później stały się fundamentem projektowania systemów IoT i M2M.

Istotna była także centralizacja nadzoru. W wielu zakładach stworzenie centralnej sterowni, gdzie operator miał dostęp do wszystkich wskaźników i manipulatorów, było przełomem organizacyjnym. To pierwszy krok w stronę późniejszych centrów NOC, SOC, czy platform zarządzania flotą urządzeń IoT. Zamiast biegania po hali – jeden punkt dowodzenia, jedna „tablica rozdzielcza” informacji.

Ta filozofia pracy z systemem przełożyła się bezpośrednio na późniejszą architekturę internetu rzeczy. Dzisiejsze rozwiązania IoT zakładają istnienie warstw: warstwa urządzeń (sensory, aktuatory), warstwa bram i sterowników, warstwa sieci, warstwa chmury i aplikacji. Dokładnie tak samo myśleli konstruktorzy pierwszych instalacji przemysłowych: lokalne elementy pola, szafy sterownicze, magistrale sygnałowe, dyspozytornia. Zmieniły się technologie, ale struktura pozostała bardzo podobna.

Patrząc na tę ewolucję, łatwiej dziś zaprojektować nawet prosty system hobbystyczny. Zamiast łączyć każde urządzenie IoT bezpośrednio z chmurą, często rozsądniej jest zbudować małą lokalną „sterownię” – choćby w postaci Raspberry Pi lub przemysłowego gatewaya – i dopiero z niej wysyłać przetworzone dane wyżej. Ta sama logika, tylko komponenty nowocześniejsze.

SCADA, PLC i DCS – przemysłowy internet rzeczy zanim był „internetem”

Programowalne sterowniki logiczne (PLC)

Na przełomie lat 60. i 70. przekaźnikowe szafy sterownicze zaczęły być coraz większym problemem. Przemysł motoryzacyjny, chemiczny i spożywczy potrzebował szybkich modyfikacji linii produkcyjnych, a „przeprzewodowywanie” tysięcy kabli stawało się logistycznym koszmarem. Odpowiedzią były programowalne sterowniki logiczne – PLC (Programmable Logic Controller).

PLC zastąpiły dziesiątki, a potem setki przekaźników jednym modułem wyposażonym w mikroprocesor, pamięć i wejścia/wyjścia binarne oraz analogowe. Logika sterowania została zapisana nie w kablach, lecz w programie – najczęściej w postaci drabinkowej (ladder logic), odwzorowującej sposób myślenia inżynierów o przekaźnikach. Zmiana algorytmu sterowania przestała wymagać fizycznych przeróbek, wystarczyło przeprogramować sterownik.

W praktyce PLC realizowały to, co dziś określa się mianem edge computing: lokalne przetwarzanie danych jak najbliżej procesu. Sterownik zaciągał stany z czujników – cyfrowych i analogowych – wykonywał logikę, generował sygnały sterujące, a do systemów nadrzędnych przekazywał jedynie wybrane informacje: alarmy, wartości pomiarowe, statusy. Minimalizowało to ruch w sieci i zwiększało odporność na awarie łączności, bo proces mógł działać lokalnie, nawet gdy komunikacja z nadrzędnym systemem była zerwana.

Typowe zastosowania PLC były bardzo szerokie:

- linie produkcyjne w fabrykach – sekwencyjne sterowanie podajnikami, robotami, prasami,

- automatyka budynkowa – sterowanie oświetleniem, klimatyzacją, windami,

- infrastruktura komunalna – oczyszczalnie ścieków, przepompownie, stacje uzdatniania wody,

- transport – sterowanie sygnalizacją świetlną, rozjazdami, systemami na dworcach.

PLC wprowadziły też ważne nawyki, które są dziś kluczowe w IoT: rozdział logiki sterowania (czas krytyczny) od warstwy wizualizacyjnej (czas miękki), redundancję sterowników w aplikacjach krytycznych, archiwizację konfiguracji i programów. Zrozumienie, gdzie w systemie „powinien mieszkać” algorytm, a gdzie jedynie prezentacja danych, jest nadal jednym z najważniejszych pytań przy projektowaniu nowoczesnych rozwiązań IoT.

Systemy SCADA i rozproszone systemy sterowania (DCS)

Równolegle z rozwojem PLC rosło zapotrzebowanie na zdalny nadzór wielu obiektów rozsianych geograficznie: stacje średniego napięcia, pompownie, stacje paliw, odcinki rurociągów. Tak narodziły się systemy SCADA (Supervisory Control and Data Acquisition). Ich zadaniem był nadrzędny monitoring – zbieranie danych z czujników, wyświetlanie stanów, generowanie alarmów i umożliwianie podstawowej ingerencji, głównie w trybie nadzorczym.

SCADA były jednym z pierwszych masowych przykładów zdalnego monitoringu bardzo wielu czujników. Czujniki nie były jeszcze „inteligentne” w dzisiejszym znaczeniu – często przesyłały tylko prosty sygnał 4–20 mA lub styk bezpotencjałowy – ale cała sieć systemu tworzyła już coś, co z dużą dozą dobrej woli można nazwać przemysłowym internetem rzeczy: tysiące punktów pomiarowych, setki sterowników, jeden nadrzędny system analizy i prezentacji.

W procesach ciągłych (rafinerie, petrochemia, duże elektrownie) pojawiły się z kolei rozproszone systemy sterowania – DCS (Distributed Control System). Zamiast jednego wielkiego kontrolera lub dużej liczby niezależnych PLC, DCS opierał się na wielu lokalnych jednostkach sterujących, rozmieszczonych blisko procesu i połączonych szybką magistralą z nadrzędną stacją operatorką. Każdy węzeł miał nieco autonomii, a centrum nadzorcze scentralizowany wgląd w całość procesu.

Transmisja w SCADA i DCS korzystała z różnych mediów: przewodowych RS-232/RS-485, dedykowanych par miedzianych, światłowodów, łączy radiowych, telefonicznych, a nawet satelitarnych. Jeszcze długo przed HTTP i MQTT inżynierowie przemysłowi musieli rozwiązać problemy, z którymi dziś mierzy się IoT: ograniczona przepustowość, duże opóźnienia, zakłócenia, a przede wszystkim bezpieczeństwo i niezawodność transmisji.

Z tych doświadczeń płyną ważne lekcje dla współczesnego IoT:

- hierarchia systemu – nie wszystko musi (i powinno) trafić do chmury; wiele decyzji należy pozostawić urządzeniom brzegowym,

- buforowanie danych – utrata łączności nie może oznaczać utraty historii pomiarów, dlatego lokalne archiwa i kolejki są kluczowe,

- alarmowanie z priorytetami – nie wszystkie zdarzenia są równe; system powinien umieć odróżnić „informację” od „alarmu o wysokim priorytecie” i reagować inaczej,

- bezpieczeństwo pracy – w procesach krytycznych logika awaryjna musi działać nawet wtedy, gdy system nadrzędny jest wyłączony lub zhakowany.

Przeniesienie tych zasad do świata rozproszonych czujników, smart home i projektów IoT pozwala uniknąć wielu pułapek. Można korzystać z chmury i nowoczesnych protokołów, ale fundamenty architektury warto czerpać z kilkudziesięciu lat doświadczeń SCADA i DCS.

Telemetria i M2M: kiedy maszyny zaczęły „rozmawiać”

Telemetria w energetyce, kosmosie i transporcie

Telemetria to zdalny pomiar i przesyłanie danych z odległych obiektów. Zanim powstało modne hasło „początki internetu rzeczy”, rakiety, satelity i statki przesyłały już strumienie danych telemetrycznych. Temperatura silnika, ciśnienie w zbiornikach, wibracje konstrukcji – bez tych danych misje kosmiczne po prostu by się nie odbyły. Zespół naziemny śledził parametry w czasie rzeczywistym i podejmował decyzje, czasem wysyłając komendy zwrotne.

Od impulsów po pakiety: jak telemetria schodziła „na ziemię”

Pierwsze systemy telemetryczne w energetyce i transporcie korzystały z bardzo skromnych łączy. Często był to pojedynczy tor telefoniczny, linia radiowa z modulacją częstotliwości lub specjalnie wydzielona para przewodów. Informacje o stanie pola rozdzielni, poziomie wody w zbiorniku czy lokalizacji pociągu kodowano w postaci impulsów, tonów lub prostych ramek binarnych. Technologia prymitywna z dzisiejszej perspektywy, ale kluczowa: umożliwiała decyzje na odległość bez obecności człowieka na miejscu.

W elektroenergetyce stacje transformatorowe zaczęły „meldować się” do dyspozytorni: napięcia, prądy, stany wyłączników, sygnały zabezpieczeń. Dyspozytor miał mapę sieci przed sobą, wiedział, gdzie nastąpiła awaria, mógł zdalnie przełączyć zasilanie czy wyłączyć fragment sieci. To prawie jak dashboard w nowoczesnej platformie IoT, tylko że zbudowany na bazie przekaźników, prostych protokołów i drukarek igłowych.

Na kolei telemetria objęła nie tylko sygnalizację, ale też nadzór pociągów: rejestrację prędkości, liczby hamowań, czasu pracy maszynisty. Rejestratory „czarne skrzynki” to nic innego jak bardzo wczesne data loggery. Dane nie zawsze były transmitowane w czasie rzeczywistym – czasem odczytywano je dopiero w warsztacie – ale filozofia była ta sama: maszyna generuje dane, które później służą do analizy, optymalizacji i bezpieczeństwa.

Kluczowy wniosek z tej epoki: najpierw pojawiła się potrzeba decyzji na podstawie danych, dopiero później rozbudowane standardy i protokoły. To dobra wskazówka dla własnych projektów IoT – zacząć od jasnego pytania „po co mi te dane?”, a dopiero później zastanawiać się, jak je elegancko spakować i przesłać.

Pierwsze protokoły branżowe – przodkowie MQTT i CoAP

Wraz z rozwojem telemetrii energetyka, gazownictwo czy koleje wypracowały własne standardy komunikacyjne. Powstały protokoły, które dziś mogą wyglądać archaicznie, ale rozwiązywały dokładnie te same problemy, które próbują ugryźć nowoczesne protokoły IoT.

Najważniejsze wyzwania były zaskakująco aktualne:

- jak przesłać wiele różnych sygnałów (stany binarne, pomiary analogowe, alarmy) jednym łączem,

- jak mieć pewność, że dana komenda dotarła i została wykonana,

- jak ograniczyć ilość danych, żeby nie zapchać wąskiego kanału,

- jak odróżnić „normalne raportowanie” od sytuacji alarmowej.

Standardy takie jak IEC 60870-5 w energetyce czy liczne protokoły właścicielskie w telemetrii gazowej i wodociągowej implementowały mechanizmy kwitowania ramek, retransmisji, czasów oczekiwania, priorytetów. Zanim świat usłyszał o MQTT z jego lekkim publish/subscribe, operatorzy sieci energetycznych od lat korzystali z asynchronicznej, zdarzeniowej komunikacji z polami rozdzielni i stacjami pośrednimi.

Dla twórcy dzisiejszego systemu IoT lektura dokumentacji starego protokołu telemetrycznego może być zaskakująco inspirująca. Tam widać, jak w praktyce rozwiązywano problem „mało, ale niezawodnie”, bez możliwości „dosypania megabitów”. Przekładając to na współczesność: nawet jeśli masz szybkie LTE czy światłowód, myśl jak projektant protokołu dla łącza radiowego sprzed 30 lat – każdy bajt ma znaczenie.

M2M w telekomunikacji: SIM-y, modemy i pierwsze floty urządzeń

Kiedy sieci komórkowe stały się powszechne, naturalnym krokiem było wpięcie do nich urządzeń innych niż telefony. Tak zrodził się nurt M2M (Machine to Machine). Operatorzy zaczęli oferować specjalne karty SIM do zastosowań telemetrycznych: liczników energii, bankomatów, automatów sprzedających, systemów alarmowych, kas fiskalnych, a później całych flot ciężarówek.

Technicznie były to proste konstrukcje: moduł GSM lub GPRS, czasem zewnętrzny mikrokontroler i kilka wejść/wyjść. Komunikacja przebiegała przez SMS, połączenia CSD (komutowane dane) albo proste TCP/IP. Jednak z punktu widzenia architektury to już był pełnoprawny „internet rzeczy”: setki tysięcy, potem miliony urządzeń, każde z własną tożsamością (numerem MSISDN, numerem SIM), komunikujące się z centralnym serwerem.

To w świecie M2M pojawiły się praktyczne odpowiedzi na kilka istotnych pytań:

- jak zarządzać zdalnie aktualizacjami oprogramowania w setkach tysięcy urządzeń,

- jak rozliczać transmisję danych w sposób przewidywalny kosztowo,

- jak identyfikować i autoryzować urządzenia bez udziału użytkownika,

- jak projektować komunikaty, by były małe, ale zawierały wszystko, co potrzebne.

Jeśli dziś uruchamiasz flotę trackerów GPS w samochodach albo inteligentne liczniki, korzystasz pośrednio z doświadczeń operatorów i integratorów M2M z przełomu lat 90. i 2000. Wtedy uczono się, że zdalny restart, aktualizacja firmware’u OTA (Over-The-Air) czy precyzyjne logowanie zdarzeń to nie „nice to have”, tylko absolutna konieczność przy dużej skali.

Przeniesienie tego myślenia do własnych projektów – nawet hobbystycznych – szybko procentuje. Jeśli od początku przewidzisz zdalną diagnostykę i możliwość zmiany konfiguracji urządzeń, unikniesz w przyszłości wypraw terenowych „żeby wgrać nowy soft” lub „zmienić jeden parametr”.

Gdy bankomat przestaje być „pudełkiem” – M2M w usługach

Dla wielu branż przełomem było uświadomienie sobie, że zdalna łączność zmienia sam model biznesowy. Bankomaty, parkomaty, biletomaty, automaty vendingowe – te urządzenia długo były traktowane jak osobne wyspy. Ktoś co jakiś czas przychodził, uzupełniał gotówkę lub towar, robił manualny odczyt liczników i rozliczeń.

Dodanie modułu M2M sprawiło, że nagle wszystko stało się bardziej przewidywalne i skalowalne:

- operator automatu widział w systemie centralnym poziom towaru i mógł optymalizować trasy uzupełnień,

- bank wiedział, które bankomaty kończą gotówkę i gdzie ryzyko przerwy w dostępności jest największe,

- miasto mogło analizować wykorzystanie parkomatów i planować politykę parkingową na podstawie realnych danych.

To typowy przykład, jak proste czujniki (stan kasety, licznik transakcji, drzwi otwarte/zamknięte) w połączeniu z łącznością i centralnym systemem tworzą nową jakość. Dzisiejsze IoT w logistyce czy retailu opiera się na dokładnie tym samym mechanizmie, tylko ma do dyspozycji tańsze sensory, szybsze sieci i chmurę.

Patrząc na te zastosowania, łatwo znaleźć analogie do własnych pomysłów: czy urządzenie, które dziś traktujesz jako „samodzielne pudełko”, nie zyskałoby nowej wartości, gdyby zaczęło wysyłać dane o swoim stanie i otoczeniu?

Ewolucja czujników: od analogowych transduktorów do inteligentnych sensorów

Transduktory i klasyka: 4–20 mA, 0–10 V i PT100

W początkach automatyki przemysłowej czujnik był elementem czysto analogowym. Termopara generowała niewielkie napięcie proporcjonalne do różnicy temperatur, tensometr zmieniał opór pod obciążeniem, przetwornik ciśnienia wyginał membranę i tym samym modyfikował parametry mostka Wheatstone’a. Żadnej inteligencji, zero cyfry – tylko fizyka i prosta elektronika.

By te delikatne sygnały można było przesyłać na większe odległości, upowszechniły się standardy prądowe i napięciowe, przede wszystkim pętla prądowa 4–20 mA oraz sygnał 0–10 V. Zakres 4–20 mA miał sprytną cechę: wartość 0 mA oznaczała przerwę w obwodzie lub uszkodzenie czujnika, więc system łatwiej wykrywał awarię. Dla automatyka zrozumienie tych zasad było podstawą – i nadal się przydaje, gdy trzeba integrować stare instalacje z nową elektroniką IoT.

Wiele procesów opierało się na standardowych typach czujników temperatury, takich jak PT100 czy PT1000. Umożliwiały dokładny pomiar dzięki przewidywalnej zmianie rezystancji z temperaturą. Choć dziś często chowa się je za kolorowymi obudowami „smart sensorów”, ich serce nadal opiera się na tych samych zjawiskach fizycznych, co kilkadziesiąt lat temu.

Znajomość tradycyjnych transduktorów to mocna przewaga przy modernizacji starszych instalacji. Zamiast wymieniać wszystko na „cyfrowe”, można wpiąć się w istniejące sygnały 4–20 mA i 0–10 V za pomocą przetworników A/C podłączonych do mikrokontrolera i w ten sposób wciągnąć je w świat IoT.

Od prostego sygnału do cyfrowych magistral: HART, Modbus, CAN

Kolejnym etapem było „podszycie” analogowego sygnału cyfrową informacją. Przykładem jest protokół HART (Highway Addressable Remote Transducer), który nakłada sygnał cyfrowy na klasyczną pętlę 4–20 mA. Dla sterownika proces wygląda jak zwykły analog, ale serwisant może „podsłuchać” dodatkowe dane: identyfikator urządzenia, parametry kalibracyjne, diagnostykę.

Podobnie Modbus – początkowo w wariancie RTU na RS-485 – pozwolił czujnikom i przetwornikom przesyłać cyfrowe wartości rejestrów. Odległość między czujnikiem a systemem nadrzędnym wydłużyła się, liczba parametrów w jednym urządzeniu wzrosła, a struktura komunikacji stała się bardziej elastyczna. Nagle jeden przewód mógł obsłużyć szeregowo wiele urządzeń, zamiast dedykowanej pary dla każdego pomiaru.

W motoryzacji pojawiła się magistrala CAN, która umożliwiła komunikację między sterownikami i czujnikami w pojeździe. To dzięki niej samochód mógł zgłaszać błędy z konkretnych modułów, a liczne sensory współdzieliły jedną sieć. Dzisiejsze rozwiązania IoT w przemyśle i transporcie często korzystają z tych samych protokołów lub ich pochodnych, bo są sprawdzone, odporne na zakłócenia i dobrze opisane.

W praktyce oznacza to, że projektując system IoT w środowisku przemysłowym, nie trzeba wymyślać wszystkiego od zera. Lepiej przyjąć, że „świat poniżej” – czujniki i moduły wykonawcze – mówią Modbusem, CAN-em albo HART-em, a dopiero brama (gateway) konwertuje te dane na MQTT, HTTP czy inne protokoły chmurowe.

Sensory MEMS i miniaturyzacja: kiedy „czujnik” stał się układem scalonym

Rewolucja nastąpiła, gdy technologia MEMS (Micro-Electro-Mechanical Systems) pozwoliła zbudować mikromechaniczne struktury na krzemie. Akcelerometry, żyroskopy, barometry, mikrofony – wszystko to zaczęło mieścić się w kilku milimetrach kwadratowych. Początkowo trafiały do lotnictwa i wojskowości, później do elektroniki użytkowej: telefonów, konsol do gier, dronów.

Takie sensory najczęściej komunikują się cyfrowo: przez I²C, SPI, czasem UART. Oprócz samego pomiaru mają wbudowane filtry, przetworniki A/C, rejestry konfiguracyjne, a nieraz także proste algorytmy detekcji zdarzeń (np. „wykryj wstrząs”, „wykryj położenie pionowe”). Z czysto fizycznego czujnika powstał inteligentny moduł, który wykonuje część pracy za system nadrzędny.

To właśnie miniaturyzacja i taniość sensorów MEMS sprawiły, że pomiar ruchu, wibracji czy ciśnienia stał się powszechny. Można dodać akcelerometr do opaski na rękę, czujnik ciśnienia do każdej opony, a barometr do każdego telefonu. IoT przestał być domeną wielkich zakładów – stał się możliwy w skali kieszonkowej.

Dla praktyka oznacza to jedno: niemal każdy parametr da się dziś zmierzyć małym, tanim sensorem. Wyzwaniem nie jest już sam pomiar, lecz wybór sensora o odpowiednich parametrach, jego właściwe umieszczenie w urządzeniu i sensowne przetwarzanie danych.

Inteligentne czujniki: procesor, pamięć i algorytmy na krawędzi

Kolejny krok to tzw. smart sensors – czujniki z wbudowanym mikrokontrolerem lub dedykowanym procesorem sygnałowym. Oprócz surowego pomiaru dostarczają już przetworzone informacje: liczbę kroków, wykrytą obecność, kierunek ruchu, jakość powietrza z kompensacją temperatury i wilgotności.

Przykładowo, nowoczesny czujnik jakości powietrza może sam wykonywać kompensację temperaturową, obliczać indeks jakości, wykrywać nagłe skoki zanieczyszczeń i wysyłać tylko gotowe parametry do systemu nadrzędnego. Zamiast strumienia surowych danych otrzymujesz „pigułki wiedzy”. To ogromne odciążenie dla mikrokontrolera głównego lub bramy IoT, szczególnie w systemach bateryjnych.

Inteligencja na poziomie czujnika ma jeszcze jedną zaletę: ogranicza ruch w sieci. Zamiast raportować każdą drobną zmianę, czujnik może wysyłać dane tylko wtedy, gdy wykryje istotne zdarzenie lub przekroczenie progu. To dokładnie ta sama logika, którą od dekad stosowano w systemach SCADA – i znów widać, jak doświadczenia przemysłu wracają w nowej formie.

Projektując własne rozwiązanie, dobrze jest zastanowić się, które obliczenia można „zepchnąć” do czujnika. Jeśli moduł ma wbudowane funkcje filtrowania czy detekcji, korzystaj z nich – oszczędzisz energię, pasmo i czas implementacji.

Kiedy czujnik staje się „produktem”: kalibracja, certyfikacja i niezawodność

Czujnik w katalogu wygląda niewinnie: kilka parametrów, obudowa, cena. W realnym projekcie nagle dochodzi cały „ogon” zagadnień: kalibracja, dryft, zgodność z normami, warunki środowiskowe. Tu widać, jak długą drogę przeszły rozwiązania od prostego termistora w obudowie aż po złożony moduł pomiarowy z certyfikatami ATEX, MID czy medycznymi.

W przemyśle od dawna standardem są procedury kalibracji okresowej i śledzenie wzorców. Analogowy przetwornik ciśnienia czy przepływomierz miał tabelę korekcyjną, naklejkę z datą ostatniej kalibracji i wpis w systemie jakości. Dzisiejsze inteligentne sensory przeniosły to w świat cyfrowy: współczynniki kalibracyjne siedzą w pamięci EEPROM lub flash, a informacje o „dacie ważności” można odczytać po protokole komunikacyjnym.

Pojawiły się też mechanizmy autodiagnostyki. Czujnik może sam zgłosić, że pracuje poza dopuszczalnym zakresem temperatur, przekroczył liczbę godzin pracy lub wykrył nienaturalne odchyłki sygnału. Zamiast czekać, aż pomiar „odpłynie” i popsuje proces, system otrzymuje alarm typu „zaplanuj serwis”. To jeden z najbardziej praktycznych elementów, które można wykorzystać w projektach IoT – prewencyjna diagnostyka zamiast gaszenia pożarów.

Jeśli tworzysz swoje urządzenie, opłaca się myśleć o czujniku jak o produkcie w produkcie. Nawet prosty moduł temperatury i wilgotności może mieć:

- procedurę kalibracji przy produkcji (np. zapis offsetów do pamięci),

- flagę „wymagany przegląd” po określonej liczbie cykli lub godzin pracy,

- rejestry diagnostyczne – licznik błędów, zakres temperatur pracy, minimalne/maksymalne wartości.

Taki „porządek” z poziomu hardware’u i firmware’u odwdzięczy się później łatwiejszym serwisem, mniejszą liczbą reklamacji i spokojniejszym snem, gdy twoje urządzenia zaczną pracować w setkach lokalizacji.

Czujniki jako źródło prawdy: od sygnału procesowego do danych biznesowych

W klasycznych systemach automatyki czujnik służył do sterowania procesem: utrzymać poziom w zbiorniku, temperaturę w piecu, ciśnienie w instalacji. Dla działu produkcji liczyło się, żeby maszyna trzymała parametry. IoT zrobił jeden kluczowy krok: ten sam sygnał pomiarowy stał się surowcem do analizy biznesowej.

Przepływomierz, który kiedyś karmił jedynie regulator PID, dziś zasila również system rozliczeń mediów między wydziałami. Czujniki wibracji, montowane pierwotnie tylko po to, by chronić maszynę przed uszkodzeniem, stały się podstawą systemów predykcyjnego utrzymania ruchu i planowania przestojów. Z kolei prosty czujnik otwarcia drzwi chłodni generuje dane do analizy strat energii i organizacji pracy personelu.

Ta zmiana perspektywy jest kluczowa. Ten sam pomiar może trafić równolegle:

- do sterownika, który w czasie rzeczywistym reguluje proces,

- do systemu OT (SCADA/MES), który monitoruje produkcję,

- do platformy IoT/BI, gdzie dane są agregowane, korelowane i wizualizowane dla menedżerów.

Jeśli projektujesz nowe urządzenie, zadaj sobie proste pytanie: poza funkcją sterowania, jakie decyzje biznesowe ktoś mógłby podjąć na podstawie tych pomiarów? Często wystarczy udostępnić strumień danych w ustrukturyzowanej formie (np. po MQTT lub REST), by nagle otworzyły się drzwi do dodatkowych wdrożeń i integracji.

Od zamkniętych wysp do ekosystemów: standaryzacja IoT i interoperacyjność

Dlaczego protokoły przemysłowe nie wystarczyły światu konsumenckiemu

Przemysł od lat miał swoje sprawdzone protokoły: Modbus, PROFIBUS, CAN, HART, PROFINET. Świetnie radziły sobie w fabrykach, ale kompletnie nie przystawały do świata konsumenckiego – mieszkań, biur, małych urządzeń DIY. Wymagały specjalistycznej wiedzy, drogich interfejsów i dość sztywnej konfiguracji. Gdy pojawiła się potrzeba podłączenia do sieci dziesiątek milionów żarówek, gniazdek i czujników ruchu, trzeba było poszukać innych rozwiązań.

Naturalnym kandydatem stał się IP i Wi-Fi, ale to nie był złoty środek. Stosy TCP/IP są relatywnie ciężkie, a Wi-Fi pobiera sporo energii – średnio nadaje się do ultra-tanich, bateryjnych czujników drzwi czy temperatury. Z tego powodu zaczęły robić karierę protokoły lżejsze, jak ZigBee, Z-Wave, Thread czy Bluetooth Low Energy. Ich korzenie sięgają jednak dawnych koncepcji radiowych sieci przemysłowych i telemetrii: topologie mesh, niskie przepływności, oszczędzanie energii, retransmisje pakietów.

Różnica polegała na tym, że w domu czy biurze nikt nie będzie konfigurował magistrali z laptopem serwisowym. Potrzebne były automatyczne parowanie, proste kody QR, kreatory w aplikacjach mobilnych. To wymusiło nowe podejście do warstwy użytkowej, mimo że na poziomie niższych warstw wciąż widać inspiracje z dawnych systemów M2M.

MQTT, CoAP i spółka: jak internet dogonił SCADA

Przez lata przeglądarka www znała głównie HTTP – żądanie, odpowiedź, koniec rozmowy. Tymczasem przemysł używał architektury „publikuj/subskrybuj” w systemach alarmowych i SCADA: jeden punkt wysyłał zdarzenia, wiele innych je odbierało. Kiedy IoT zaczął rosnąć, okazało się, że model request/response jest niewygodny dla miliardów małych urządzeń.

Tu na scenę wchodzi MQTT – lekki protokół, w którym urządzenie publikuje dane na temat, a inni (aplikacje, serwisy, dashboardy) subskrybują to, co im potrzebne. Świat IT pokochał tę prostotę, ale dla automatyka to brzmiało jak dawne rozwiązania znane z rozproszonych systemów nadzoru, tylko w wersji „internetowej”. Podobnie CoAP przeniósł filozofię REST na UDP i małe zasoby, dzięki czemu czujnik mógł działać tygodniami na baterii, a jednocześnie być „adresowalnym” elementem sieci.

Jeżeli chcesz zbudować system, który będzie skalował się poza jedno laboratorium czy halę, warto od razu myśleć w kategoriach publikacji danych (telemetria, logi, zdarzenia) i ich konsumpcji przez różne usługi. Dzięki temu późniejsza integracja z analityką, wizualizacją czy systemami ERP nie wymaga przerabiania fundamentów.

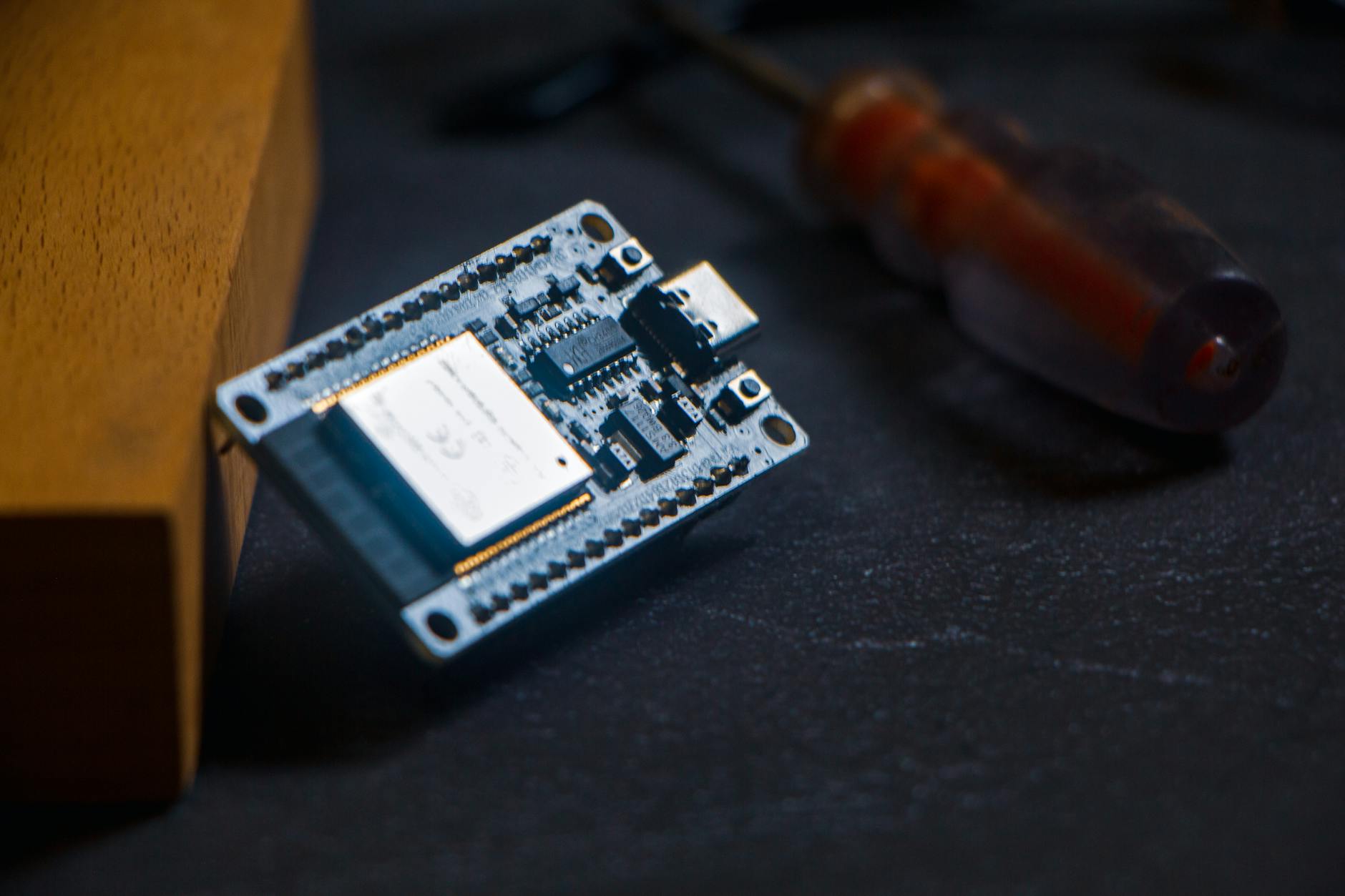

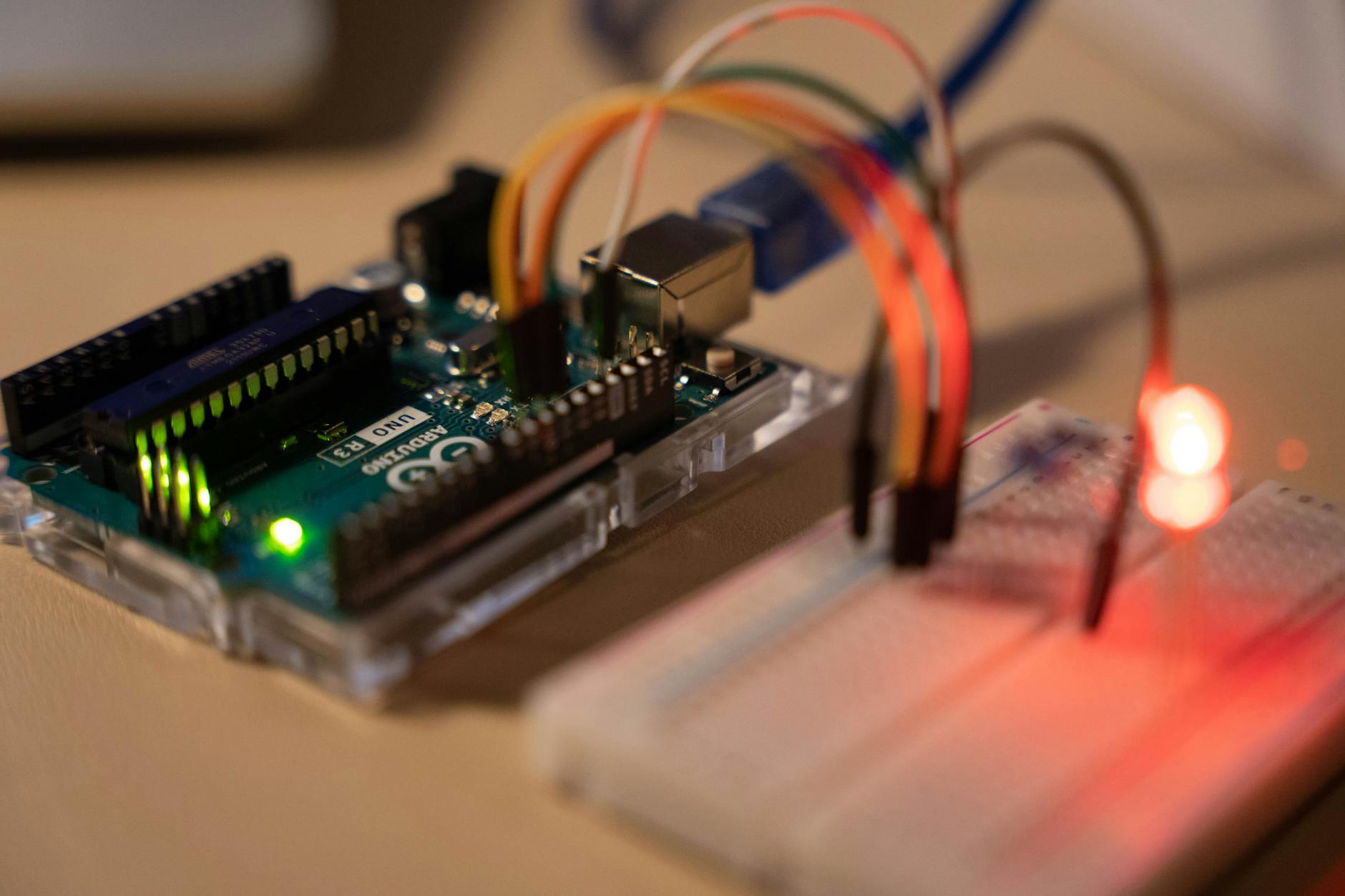

Platformy IoT vs. „składaki” DIY: gdzie kończy się hobbystyczne PoC

Pierwszy prototyp łatwo oprzeć na Raspberry Pi, ESP32 i chmurowym brokerze MQTT. Działa, mierzy, wysyła – można pokazać demo zespołowi czy klientowi. Problem pojawia się, gdy ktoś mówi: „Świetne, zróbmy tego pięćset sztuk”. Nagle liczy się nie tylko sama komunikacja, ale też aktualizacje OTA, zarządzanie certyfikatami, multi-tenant, raportowanie, integracje z innymi systemami.

Stąd popularność platform IoT (komercyjnych i open source), które rozwiązują powtarzalne elementy: rejestracja urządzeń, autoryzacja, skalowalny broker, przechowywanie danych czasowych, dashboardy, reguły zdarzeń. Funkcję dawnego SCADA rozpisano na wiele usług chmurowych, ale logika jest ta sama: zbierz dane, pokaż je człowiekowi, automatycznie zareaguj na proste reguły, udostępnij dane dalej.

Kiedy tworzysz rozwiązanie, które ma żyć dłużej niż jedno wdrożenie pilotażowe, opłaca się dość wcześnie zdefiniować „granice odpowiedzialności”: co robi sprzęt, co robi gateway, co robi platforma. Dzięki temu unikasz sytuacji, w której twoje IoT jest zestawem skryptów na jednym serwerze, którego nikt nie chce potem dotykać.

Bezpieczeństwo „zanim było modne”: czego nauczyły stare systemy zdalne

Fizyczna separacja kontra pełna łączność

W czasach, gdy zdalny dostęp był wyjątkiem, bezpieczeństwo często sprowadzało się do jednej prostej zasady: sieć sterowania jest fizycznie odcięta od świata zewnętrznego. Nie ma internetu, nie ma VPN, nie ma problemu. Nawet jeśli stosowano modemy, zwykle były to połączenia punkt–punkt, z numerami, których „nikt nie znał”. To miało swoje plusy (mniej ataków), ale też minusy – trudną zdalną diagnostykę i aktualizacje.

Rozwój IoT zburzył ten komfort. Nagle czujniki i sterowniki zaczęły wychodzić poza hale fabryczne: na pola, ulice, do mieszkań. Pojawiła się konieczność łączenia świata OT z IT. Tam, gdzie kiedyś wystarczał zamknięty system SCADA, dziś stoi gateway z LTE i chmurą w tle. To zupełnie inna ekspozycja na zagrożenia.

Paradoksalnie, doświadczenia z dawnych systemów uczą dziś pokory. Dobre praktyki z przeszłości nadal mają sens:

- separacja sieci krytycznej (sterowanie) od sieci „biurowej” i internetu,

- minimalizacja ekspozycji – nie wystawiaj czujnika bezpośrednio do sieci publicznej, korzystaj z bram,

- proste, ale skuteczne mechanizmy uprawnień – nie każdy potrzebuje dostępu do wszystkiego.

Łącząc starsze systemy z nowymi platformami IoT, opłaca się zachować „wyspiarskie” podejście tam, gdzie chodzi o bezpieczeństwo ludzi lub dużych pieniędzy, a internet traktować jako kanał uzupełniający, a nie główny mechanizm sterowania.

Klucze, certyfikaty, OTA – nowa twarz starych problemów

Problem „kto może się połączyć” istniał już w czasach modemów. Rozwiązania były proste: lista numerów, hasło, czasem fizyczny klucz sprzętowy. Dzisiejsze IoT mierzy się z tym samym pytaniem, ale w innej skali. Zamiast kilku sterowników mamy tysiące czujników, zamiast jednego modemu – wielopoziomową architekturę z brokerami, API i usługami w chmurze.

Dlatego tak ważne są mechanizmy typu:

- unikalne klucze i certyfikaty dla każdego urządzenia,

- bezpieczne aktualizacje OTA z podpisem cyfrowym firmware’u,

- rotacja kluczy i możliwość unieważnienia (revocation).

To nic innego jak rozwinięcie dawnych koncepcji kontroli dostępu, ale dopasowane do skali chmury. Jeśli dziś budujesz nawet mały system IoT, dobrze jest od razu wdrożyć choć podstawowe elementy: oddzielne dane logowania dla każdego urządzenia, szyfrowanie transportu (TLS) i mechanizm aktualizacji, który uniemożliwi wgranie niepodpisanego softu. Później łatwiej go rozwinąć, niż budować od zera, gdy system już działa w terenie.

Projektowanie współczesnego IoT z głową: lekcje z przeszłości w praktyce

Topologia, która przetrwa: gwiazda, magistrala, mesh i hierarchie

Historyczne systemy automatyki rzadko były projektowane „na oko”. Inżynier decydował: tu ma sens magistrala (RS-485), tu gwiazda (4–20 mA do każdego przetwornika), tu pierścień. Topologia była świadoma, dopasowana do warunków kablowych i wymagań niezawodności. IoT, szczególnie w wersji DIY, często zaczyna się od: „wstawmy tu Wi-Fi, a resztę zobaczymy”. To prosta droga do problemów, gdy skala urośnie.

Przy planowaniu nowoczesnego systemu warto przełożyć stare praktyki na nowe realia:

- czujniki lokalne połączone magistralą przewodową (Modbus, CAN, I²C w obrębie modułu),

- lokalne węzły lub gateway’e zbierające dane z kilku–kilkunastu urządzeń,

- sieć szkieletowa (Ethernet, LTE, światłowód) łącząca gateway’e z chmurą.

Taki podział ogranicza liczbę bezpośrednich punktów w chmurze, upraszcza zarządzanie i pozwala użyć tańszych, sprawdzonych technologii „blisko procesu”, a nowoczesnych rozwiązań sieciowych i chmurowych tam, gdzie to ma największy sens. Zamiast zastanawiać się, czy każde urządzenie „musi mieć Wi-Fi”, budujesz spójną, warstwową architekturę.

Energia, serwis i cykl życia: projektowanie na lata, nie na hackathon

Stare systemy telemetrii i M2M często zakładano „na dekadę”: czujnik w studni, przepompowni czy na dachu miał działać długo i przewidywalnie. Wymuszało to rozsądne podejście do zużycia energii, trwałości obudów, dostępności do serwisu. W świecie nowoczesnych gadżetów IoT łatwo o tym zapomnieć – dopóki ktoś nie musi fizycznie wymienić baterii w setkach punktów.

Praktyczne pytania z tamtych czasów nadal są aktualne:

- jak często urządzenie naprawdę musi wysyłać dane – co minutę, godzinę, dzień?

- czy można zrobić lokalną agregację i wysyłać zbiorcze informacje zamiast każdego pomiaru?

- czy miejsce montażu pozwala na wygodny dostęp serwisowy, czy każda operacja wymaga drabiny i dwóch osób?

Świadome odpowiedzi na te pytania zwykle prowadzą do prostych, ale skutecznych decyzji: mocniejsza bateria, rzadsze raportowanie, tryby uśpienia, lepsza obudowa, złącza ułatwiające wymianę modułu. Dzięki temu twoje IoT zachowuje się bardziej jak profesjonalna instalacja niż jak zabawka, która przestaje działać po pierwszej zimie.

Od pilota do standardu: jak nie utknąć w „wiecznym PoC”

Najczęściej zadawane pytania (FAQ)

Co istniało przed IoT i jak to się wtedy nazywało?

Na długo przed pojawieniem się hasła „Internet of Things” funkcjonowały systemy o bardzo podobnej funkcji, ale z innymi nazwami: telemetria, automatyka przemysłowa, M2M (machine-to-machine), SCADA, DCS czy po prostu systemy wbudowane. Łączyły one czujniki, sterowniki i sieci komunikacyjne, tyle że głównie w przemyśle, energetyce i transporcie.

Przykłady to zdalnie monitorowane węzły cieplne, systemy alarmowe w bankach z powiadamianiem do centrali, telemetria w energetyce z odczytem stanów wyłączników czy pierwsze terminale płatnicze łączące się po liniach telefonicznych. Mechanizmy były podobne do dzisiejszego IoT, tylko nikt nie mówił wtedy „smart” i „cloud”.

Zrozumienie tych historycznych rozwiązań pomaga dziś trzeźwo patrzeć na nowe „modne” technologie i wybierać to, co realnie rozwiązuje problem.

Czym różni się „stare” M2M i SCADA od współczesnego IoT?

Klasyczne systemy M2M i SCADA były zwykle zamknięte, projektowane pod konkretny zakład lub infrastrukturę i oparte na dedykowanych protokołach oraz sieciach. Komunikacja przebiegała najczęściej po liniach kablowych, łączach radiowych lub specjalistycznych magistralach, a dostęp do systemu miała niewielka grupa operatorów w sterowni.

Dzisiejsze IoT wykorzystuje powszechny Internet, protokoły zbliżone do webowych, chmurę i aplikacje mobilne. Zamiast jednego zakładu możemy mieć miliony urządzeń w różnych miejscach świata, a dane są przetwarzane w czasie rzeczywistym i analizowane hurtowo. Logika jednak pozostaje ta sama: czujnik — komunikacja — przetwarzanie — reakcja.

Jeśli projektujesz nowy system, możesz śmiało korzystać z dojrzałych wzorców SCADA czy M2M, a dopiero potem decydować, co faktycznie przenosić do chmury.

Dlaczego znajomość historii IoT, SCADA i M2M jest praktycznie przydatna?

Historia tych systemów pokazuje, które koncepcje zostały już dawno sprawdzone: redundancja, separacja obwodów bezpieczeństwa, hierarchiczne sterowanie, centralna sterownia. Dzięki temu łatwiej odróżnić sprawdzone praktyki od chwilowych marketingowych mód i uniknąć kosztownych eksperymentów na produkcji.

Świadomy inżynier potrafi zdecydować, kiedy wystarczy prosty PLC i telemetria, a kiedy opłaca się inwestować w chmurę, analitykę czasu rzeczywistego czy zaawansowane platformy IoT. To realne oszczędności czasu, pieniędzy i nerwów na etapie wdrożenia i utrzymania.

Im lepiej rozumiesz, jak „to samo” robiono 20–30 lat temu, tym pewniej projektujesz własne systemy i rozmawiasz z dostawcami technologii.

Jakie były pierwsze czujniki i systemy automatyki przed erą elektroniki?

Początki to czysto mechaniczne i elektromechaniczne rozwiązania. Klasyczne przykłady to regulator odśrodkowy Watta w maszynach parowych, termostaty bimetaliczne, wyłączniki ciśnieniowe, pływakowe sygnalizatory poziomu czy przekaźniki i styczniki budujące układy typu „jeżeli X to Y”. Te urządzenia mierzyły wielkość fizyczną i od razu na nią reagowały – bez udziału komputera.

W zakładach przemysłowych powstawały ogromne przekaźnikowe szafy sterownicze, gdzie każda zmiana algorytmu wymagała fizycznego „przeprzewodowania” instalacji. Dane z analogowych przyrządów (manometry, termometry, wskaźniki poziomu) odczytywał człowiek, notował i podejmował decyzje – pełnił funkcję „żywego łącza danych”.

Jeśli dziś bawisz się w automatyzację, dobrze jest zobaczyć, że wiele współczesnych pomysłów to po prostu cyfrowa wersja dawnych, sprytnych mechanizmów.

Co to jest PLC, SCADA i DCS i jaki mają związek z IoT?

PLC (Programmable Logic Controller) to programowalny sterownik logiczny, który zastąpił przekaźnikowe szafy. Logika sterowania jest zapisana w programie, a nie w kablach. SCADA (Supervisory Control And Data Acquisition) to system nadzoru i akwizycji danych – zbiera sygnały z wielu sterowników, prezentuje je operatorom i pozwala na zdalne sterowanie. DCS (Distributed Control System) to rozproszony system sterowania, typowy np. dla dużych instalacji procesowych.

Te technologie tworzyły przemysłowy „internet rzeczy” zanim pojawiło się samo słowo IoT. Mieliśmy już warstwę urządzeń (czujniki, aktuatory), sterowniki (PLC, moduły DCS), sieci komunikacyjne i centralną wizualizację (SCADA). Dzisiejsze IoT w dużej mierze rozszerza te koncepcje poza przemysł, dodając chmurę, API i masową skalę.

Jeśli opanujesz podstawy PLC i SCADA, zrozumienie nawet bardzo nowoczesnych platform IoT staje się zdecydowanie prostsze.

Jak doświadczenia z przemysłowych systemów mogą pomóc w projektowaniu smart home i małych projektów IoT?

Przemysł od dawna stosuje warstwową architekturę: poziom pola (czujniki, aktuatory), poziom sterowania (PLC), poziom nadzoru (SCADA) i wyższe systemy analityczne. Ten sam schemat świetnie sprawdza się w domu czy małej firmie: lokalne urządzenia, lokalny „mózg” (np. Raspberry Pi, Home Assistant, przemysłowy gateway), a dopiero wyżej integracja z chmurą.

Taka struktura ułatwia:

- odseparowanie krytycznych funkcji (np. ogrzewanie, alarm) od Internetu,

- zmniejszenie ruchu danych do chmury – wysyłasz już przetworzone informacje,

- łatwiejsze serwisowanie i rozbudowę systemu, bo wszystko ma swoje miejsce.

Warto brać z przemysłu te sprawdzone wzorce, bo dzięki nim nawet amatorski projekt staje się stabilniejszy i mniej awaryjny.

Jak odróżnić rzeczywisty postęp w IoT od marketingowych „buzzwordów”?

Dobrym filtrem jest zadanie kilku prostych pytań: jaki realny problem biznesowy lub techniczny rozwiązuje ta technologia, czego nie da się zrobić starymi metodami (np. PLC + prosta telemetria), jak zmienia się bezpieczeństwo i koszt utrzymania systemu. Jeśli jedyną przewagą są modne hasła typu „AI”, „edge” czy „cloud”, warto włączyć czujność.

Historia IoT pokazuje, że największy postęp zwykle dotyczył:

- spadku kosztów (mikrokontrolery, łączność, pamięć),

- łatwości skalowania (od kilku do tysięcy urządzeń),

- dostępności danych w czasie rzeczywistym dla wielu użytkowników.

Jeżeli rozwiązanie faktycznie ułatwia choć jedną z tych rzeczy – jest szansa, że to coś więcej niż marketing.