Po co w ogóle testy A/B modeli ML i kiedy ich używać

Offline vs online: dlaczego dobry model na walidacji może szkodzić biznesowi

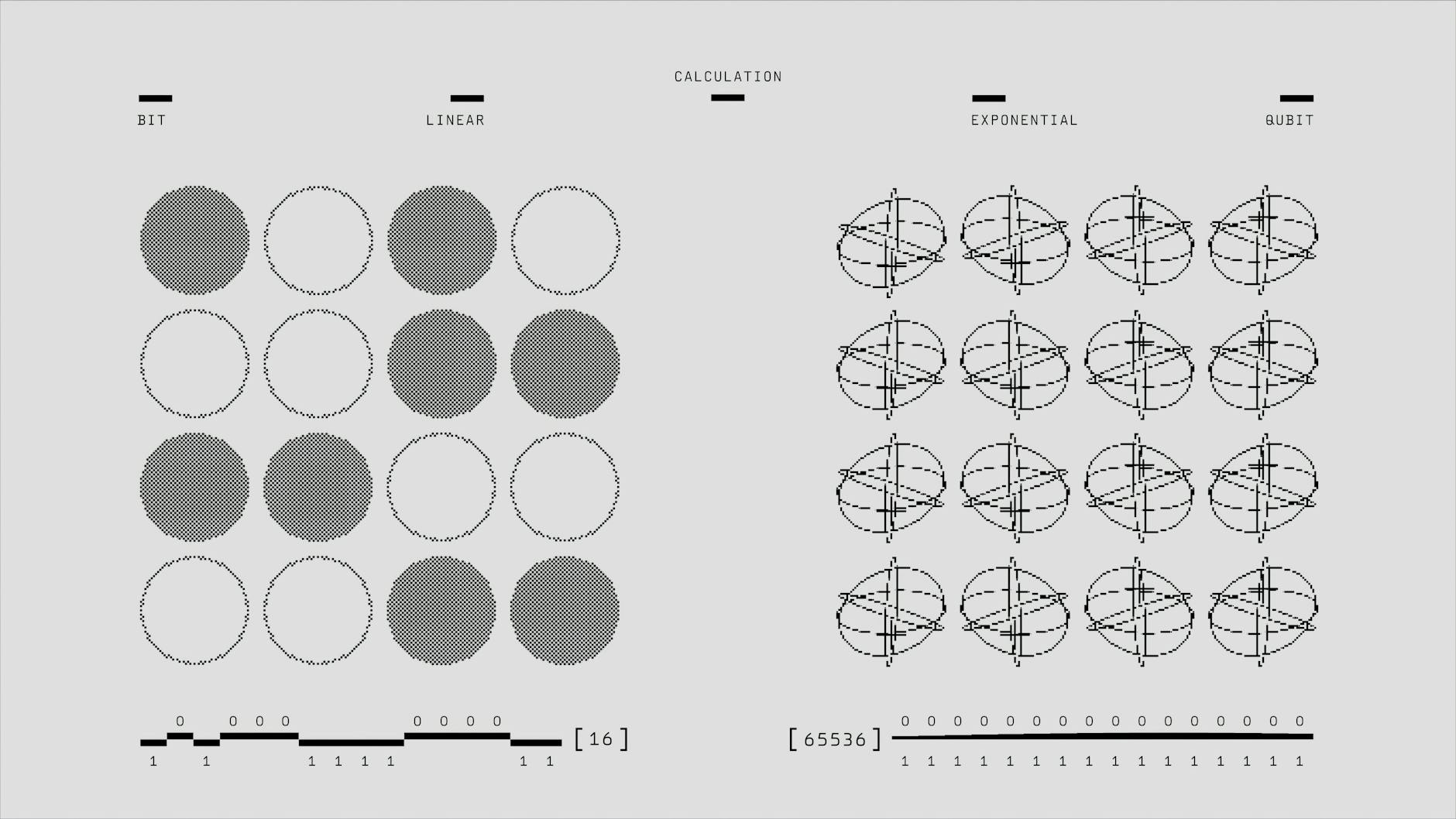

Modele machine learning tradycyjnie ocenia się na zbiorach walidacyjnych i testowych. Służą do tego metryki takie jak AUC, logloss, precision, recall czy NDCG. Pokazują one, jak dobrze model radzi sobie z przewidywaniem etykiet w danych historycznych. Te wyniki są potrzebne, ale nie mówią nic bezpośrednio o tym, ile pieniędzy zarobi lub straci biznes po wdrożeniu modelu.

Testy A/B modeli ML działają na poziomie efektu biznesowego online: liczby zakupów, przychodu, CTR, liczby zgłoszeń do supportu, marży, ryzyka fraudu. Ten efekt jest wynikiem nie tylko jakości predykcyjnej, ale też sposobu użycia modelu: progu decyzyjnego, logiki rekomendacji, limitów, reguł biznesowych. Model podejmujący odważniejsze decyzje może mieć lepszy recall kosztem większej liczby błędów fałszywie pozytywnych – a to może uderzyć w wynik finansowy.

Stąd podstawowa rola eksperymentów online w machine learning: sprawdzają realny wpływ modelu na zachowanie użytkowników i wskaźniki biznesowe, a nie tylko jego eleganckie własności statystyczne na danych offline.

Kiedy walidacja offline wystarczy, a kiedy potrzebny jest test na produkcji

Nie każdy model wymaga eksperymentu A/B. W praktyce warto rozróżnić trzy kategorie zastosowań:

- Modele pomocnicze / back-office – np. klasyfikacja dokumentów wewnętrznych, automatyczna kategoryzacja ticketów supportu, priorytetyzacja zadań dla agentów. Jeśli wpływ na klienta końcowego jest pośredni i mały, często wystarczy solidna walidacja offline plus testy integracyjne.

- Modele krytyczne, ale z deterministycznym wpływem – np. scoring kredytowy, modele pricingowe. Tu testy A/B bywają trudne (regulacje, ryzyko), więc stosuje się często symulacje i shadow deployment. Eksperymenty online są użyteczne, ale muszą być bardzo ostrożnie zaprojektowane.

- Modele bezpośrednio zmieniające zachowanie użytkowników – rekomendacje, rankingi, personalizacja, optymalizacja kampanii marketingowych. Tu testy A/B modeli ML są praktycznie obowiązkowe, bo to użytkownik decyduje, czy kliknie, kupi, wróci, czy odinstaluje aplikację.

Jeśli decyzja o wdrożeniu dotyczy dużej części ruchu, wiąże się z istotnym ryzykiem finansowym albo może zmienić zachowanie użytkownika w sposób trudny do przewidzenia offline – eksperyment na produkcji jest jedynym wiarygodnym sposobem weryfikacji.

Typowe decyzje w ML, które warto testować A/B

Testy A/B modeli ML nie sprowadzają się tylko do porównania „stary model vs nowy model”. Można w ten sposób weryfikować cały szereg zmian:

- Nowa wersja modelu – inna architektura, nowe hiperparametry, inny algorytm (np. gradient boosting vs sieć neuronowa).

- Nowe cechy (feature’y) – dodanie sygnałów behawioralnych, danych z innych systemów, agregatów czasowych. Nawet jeśli AUC rośnie, wpływ na użytkownika nie zawsze będzie pozytywny.

- Zmiana progu decyzyjnego – np. inny threshold dla klasyfikacji fraudu, inny cut-off dla wysyłki powiadomień push, zmiana progu oferty kredytowej.

- Inna polityka rekomendacji – np. więcej nowości vs więcej bestsellerów, miks personalizacji i popularności, różny poziom dywersyfikacji listy.

- Zmiana sposobu prezentacji wyników modelu – kolejność elementów, liczba rekomendacji na ekranie, dodatkowe informacje przy decyzji modelu (np. explanation).

Każda z tych decyzji może mieć wpływ na metryki biznesowe: przychód, LTV, churn, satysfakcję użytkownika czy koszty operacyjne. Testy A/B modeli ML pozwalają zmierzyć ten wpływ w sposób kontrolowany i statystycznie poprawny.

Przykład z praktyki: lepszy AUC, gorsza konwersja

Wyobraźmy sobie zespół, który rozwija model rekomendacji produktów w e-commerce. Nowy model ma wyraźnie lepszy AUC i NDCG na danych offline. Lista rekomendacji wydaje się lepiej trafiona: więcej produktów, które użytkownik faktycznie kupił w przeszłości, znajduje się na górze rankingu.

Po wdrożeniu w testach A/B okazuje się jednak, że konwersja i przychód per użytkownik spadają. Analiza zachowań użytkowników pokazuje, że nowy model zbyt mocno zawęził listę do podobnych produktów. Użytkownicy oglądają wiele bardzo zbliżonych ofert, mają poczucie braku wyboru i częściej rezygnują z zakupu lub wychodzą na inne serwisy.

Statystycznie model lepiej przewiduje, co użytkownik „lubi”, ale biznesowo ogranicza ekspozycję na produkty komplementarne i zwiększające koszyk. Tylko eksperyment online ujawnia ten efekt. To klasyczny przykład, dlaczego testy A/B modeli ML są kluczowe dla decyzji produktowych, nawet jeśli ocena offline wygląda imponująco.

Fundamenty testów A/B w kontekście ML

Podstawowa struktura: kontrola vs eksperyment dla modelu ML

Klasyczny test A/B w ML ma prostą strukturę:

- Grupa kontrolna (A) – użytkownicy, którzy obsługiwani są przez obecny model lub obecną logikę decyzyjną.

- Grupa eksperymentalna (B) – użytkownicy, którzy widzą działanie nowego modelu lub zmienionej logiki.

Z punktu widzenia systemu rekomendacyjnego, klasyfikatora fraudu czy modelu rankingowego oznacza to, że ruch jest dzielony pomiędzy dwa różne pipelines predykcyjne. Dla każdego requestu, sesji lub użytkownika system wybiera, czy użyć modelu A, czy modelu B, a następnie mierzy końcowe zachowanie użytkownika i wynik biznesowy.

Kluczowa jest tu spójność: ten sam użytkownik w danym eksperymencie nie powinien „przeskakiwać” pomiędzy modelami, o ile jednostką losowania jest użytkownik. Dzięki temu porównanie jest uczciwe, a efekt modelu nie miesza się z efektem przyzwyczajenia czy wcześniejszych interakcji.

Co losować: użytkownik, sesja czy request?

Losowanie do grup eksperymentalnych może odbywać się na różnych poziomach:

- Użytkownik (user-level randomization) – każdy użytkownik jest niezmiennie przypisany do jednej grupy. To najczęstszy sposób w produktach konsumenckich, gdzie ważne jest zachowanie spójnego doświadczenia.

- Sesja (session-level) – różne sesje tego samego użytkownika mogą trafić do różnych grup. Przydatne w kontekstach, gdzie sesje są mało zależne od siebie, ale rzadko idealne w D2C.

- Request (request-level) – każda pojedyncza prośba o rekomendację lub predykcję jest losowana osobno. Sprawdza się przy bardzo niskim zaangażowaniu użytkowników lub gdy chcemy maksymalnie wykorzystać ruch, ale tworzy silne korelacje pomiędzy próbkami.

Wybór jednostki losowania ma bezpośredni wpływ na założenia statystyczne i interpretację wyników. W większości eksperymentów z modelami ML skierowanymi do ludzi bezpiecznym domyślnym wyborem jest losowanie na poziomie użytkownika. Zmniejsza to problem powiązanych obserwacji i ułatwia analizę metryk „per user”.

Założenia klasycznego testu A/B i ich naruszenia w ML

Testy A/B opierają się na kilku kluczowych założeniach statystycznych:

- Niezależność próbek – wyniki poszczególnych jednostek (użytkowników, sesji) nie wpływają na siebie.

- Stacjonarność – rozkład populacji i zachowań nie zmienia się znacząco w czasie trwania testu.

- Brak efektów spillover – działanie na grupie B nie wpływa na zachowanie grupy A.

Modele ML często naruszają te założenia. Użytkownicy rekomendacji mogą wzajemnie wpływać na trend popularności produktów (efekt sieciowy). Systemy uczące się online (learning to rank w czasie rzeczywistym, systemy reklamowe) zmieniają rozkład predykcji w trakcie trwania eksperymentu. Z kolei decyzje jednego modelu (np. blokowanie fraudu) wpływają na zachowanie pozostałych użytkowników lub oszustów.

Dlatego przy projektowaniu eksperymentów online w machine learning trzeba świadomie ograniczać te problemy: odpowiednio dobierać jednostkę losowania, unikać mieszania ruchu między grupami poprzez mechanizmy „poleć znajomemu”, zabezpieczać się przed dryfem sezonowym odpowiednim czasem trwania i momentem startu testu.

Rola hipotez: jak mówić o H0 i H1 w języku produktu

Każdy test A/B modeli ML powinien mieć jasno zdefiniowaną hipotezę:

- H0 (hipoteza zerowa) – nowy model nie różni się od starego pod względem kluczowej metryki (np. przychodu per użytkownik).

- H1 (hipoteza alternatywna) – nowy model jest lepszy (lub po prostu „inny”) niż stary pod względem tej metryki.

W praktyce produktowej można to przełożyć na zdanie: „Zakładamy, że nowy model zwiększy przychód per użytkownik o co najmniej X%”. Test statystyczny ma pomóc zdecydować, czy zebrane dane wystarczają, aby odrzucić H0 (czyli stwierdzić, że różnica jest nieprzypadkowa) przy akceptowalnym poziomie ryzyka.

Ważny jest również kierunek hipotezy. W wielu eksperymentach ML interesuje nas, czy nowy model jest lepszy, ale również, czy nie jest istotnie gorszy. Dla krytycznych systemów sensowny bywa test non-inferiority: akceptujemy model, jeśli nie jest istotnie gorszy od starego o więcej niż określony margines, bo np. daje inne korzyści (łatwiejsza utrzymalność, niższe koszty obliczeń).

Jak dobrać i zdefiniować metryki dla testu A/B modeli

Metryki modelowe vs metryki eksperymentu online

Metryki modelowe opisują jakość predykcyjną modelu:

- AUC – jak dobrze model rozróżnia pozytywy od negatywów.

- Logloss – jakość skalowania prawdopodobieństw.

- Precision/recall, F1 – równowaga między trafnością a kompletnością.

- NDCG, MRR – jakość rankingu.

Metryki testów A/B modeli ML opisują zachowanie użytkowników i efekt biznesowy:

- CTR – odsetek kliknięć w rekomendacje lub reklamy.

- Konwersja – odsetek użytkowników wykonujących pożądaną akcję (zakup, rejestracja).

- Przychód per użytkownik, marża, LTV.

- Fraud rate, liczba fałszywych alarmów, straty z tytułu oszustw.

- Czas odpowiedzi systemu, liczba błędów – jako metryki „guardrail”.

Testy A/B modeli ML muszą skupiać się przede wszystkim na metrykach eksperymentu online, nawet jeśli decyzja o wdrożeniu modelu uwzględnia również wyniki offline. Lepszy AUC to sygnał, że nowy model może być obiecujący, ale dopiero wzrost CTR, konwersji czy przychodu dowodzi, że warto go szeroko wdrożyć.

Metryka główna i metryki „guardrail”

Każdy eksperyment powinien mieć jedną główną metrykę decyzyjną. To na jej podstawie zapada decyzja: wdrażamy nowy model czy nie. W przypadku systemu rekomendacji może to być przychód per użytkownik, w systemie antyfraudowym – strata na fraud per transakcja, w personalizacji feedu – dzienny czas spędzony w aplikacji.

Oprócz tego definiuje się metryki pomocnicze (guardrail metrics), które mają chronić przed niepożądanymi efektami ubocznymi. Przykłady:

- Wzrost przychodu przy jednoczesnym braku spadku satysfakcji użytkownika mierzonej NPS-em czy liczbą skarg.

- Lepsze wykrywanie fraudu bez nadmiernego wzrostu fałszywych pozytywów, które blokują uczciwych klientów.

- Wyższa konwersja bez znaczącego wzrostu czasu odpowiedzi systemu lub liczby błędów.

W decyzji produktowej oznacza to prostą zasadę: nowy model musi poprawić metrykę główną i nie pogorszyć poważnie żadnej z metryk guardrail. Bez tego możemy „wygrać” jedną liczbę kosztem doświadczenia użytkownika lub stabilności systemu.

Metryki na poziomie użytkownika czy na poziomie zdarzenia

Testy A/B modeli ML często mierzą dane zachowania: kliknięcia, odsłony, transakcje. Pojawia się pytanie, na jakim poziomie agregować metryki:

Jak agregować metryki i czego unikać przy liczeniu „per user”

Przy modelach ML najczęściej stosuje się dwa podejścia do metryk:

- Per event – np. CTR liczony jako kliknięcia / odsłony.

- Per user – np. przychód per użytkownik, liczony jako suma przychodu dla użytkownika w czasie testu.

Metryki „per event” są proste, ale mają pułapkę: użytkownicy mocno aktywni dominują średnią. Jeśli garstka heavy userów zachowuje się inaczej w grupie B niż w A, to różnica w CTR może tak naprawdę mówić o zmianie zachowania kilku osób, a nie całej populacji.

Bezpieczniejszy domyślny wybór przy testach modeli to metryki per user. Dla każdego użytkownika liczysz:

- łączny przychód,

- łączną liczbę kliknięć,

- łączną liczbę odsłon,

- czas spędzony w aplikacji itp.

Następnie porównujesz średnią tych wartości pomiędzy grupami A i B. Dzięki temu każdy użytkownik ma równą wagę, a klasyczne testy statystyczne działają zgodnie z założeniami.

Typowe błędy przy agregacji:

- Podwójne liczenie użytkowników – użytkownik migruje między grupami (np. z powodu błędnego mechanizmu przypisania) i pojawia się w obu. To psuje niezależność próbek.

- Agregacja mieszana – część metryki liczona per user, część per event, a potem wyciągane wnioski, jakby wszystko było w jednej jednostce. Trzeba jasno oddzielić metryki i sposób liczenia.

- Ignorowanie użytkowników bez zdarzeń – np. liczysz średni przychód tylko dla osób, które kupiły. Gubisz informację o konwersji. Do średniej powinny wejść też zera.

Kompozytowe metryki biznesowe dla modeli ML

W wielu zastosowaniach pojedyncza metryka nie opisuje dobrze wpływu modelu. Przydają się metryki kompozytowe, które łączą kilka aspektów w jedną liczbę:

- Profit per user = przychód – koszt (np. koszt reklam, koszt inferencji GPU, rabaty).

- Expected loss w antyfraudzie, gdzie uwzględniasz zarówno oszustwa, jak i koszt błędnej blokady uczciwego klienta.

- Weighted engagement score, łączący odsłony, kliknięcia, czas spędzony, z różnymi wagami.

Takie metryki lepiej oddają realny trade-off modelu. Przykład: nowy ranker podbija CTR, ale promuje tańsze produkty. Prostym CTR-em „wygląda” świetnie, a kompozytowy profit per user pokazuje spadek.

Przy metrykach kompozytowych ważne są dwie rzeczy:

- Uzgodniony wzór – biznes, data science i inżynieria muszą rozumieć, co dokładnie wchodzi do metryki i jak jest ważone.

- Stabilność w czasie – częste zmiany definicji metryki uniemożliwiają porównywanie testów historycznie. Lepiej rzadziej, ale świadomie zmieniać definicję.

Planowanie eksperymentu: wielkość próby, czas trwania, moc testu

Jak przełożyć „chcemy +X%” na wielkość próby

Planowanie zaczyna się od odpowiedzi na trzy pytania:

- Jaki minimalny efekt chcesz wykryć? (Minimal Detectable Effect, MDE) – np. +2% do przychodu per user.

- Jakie ryzyko fałszywego alarmu akceptujesz? (poziom istotności, alfa) – typowo 0,05.

- Jaką moc testu potrzebujesz? (power) – często 0,8 lub 0,9.

Znając wariancję metryki historycznie, możesz obliczyć wymaganą liczbę użytkowników na grupę. Standardowe kalkulatory A/B (także open-source) wymagają średniej, odchylenia standardowego i MDE. Przy testach modeli ML dobrze jest użyć danych z podobnych eksperymentów lub z holdoutu starego modelu.

Jeśli wychodzi bardzo duża liczba użytkowników, masz trzy opcje:

- zaakceptować większy MDE (czyli wykrywać tylko większe efekty),

- wydłużyć czas trwania testu,

- zastosować techniki zmniejszania wariancji (o tym dalej).

Dobór czasu trwania: sezonowość i zachowania użytkowników

Czas trwania eksperymentu nie wynika tylko z liczby użytkowników. Liczą się też:

- Cykl zachowań użytkownika – w e‑commerce użytkownik często potrzebuje kilku dni od pierwszej wizyty do zakupu.

- Sezonowość – dzień tygodnia, paydaye, święta, kampanie marketingowe.

- Latencja metryki – np. LTV mierzone po 30 dniach od pozyskania użytkownika.

Minimalnie test powinien obejmować pełen cykl tygodniowy, a przy wolnych procesach decyzyjnych – co najmniej dwa tygodnie. W przypadku modeli wpływających na retencję czy LTV realne może być prowadzenie eksperymentu w kilku fazach: najpierw krótszy test na twarde metryki (CTR, konwersja), potem dłuższy follow-up na retencję.

Kontrola poziomu błędów: alfa, beta i praktyczne kompromisy

W testach modeli ML poziom ryzyka jest różny w zależności od domeny:

- w eksperymentach na rekomendacjach treści ryzyko jest głównie biznesowe,

- w antyfraudzie czy systemach kredytowych dochodzi ryzyko prawne i reputacyjne.

Dlatego parametry statystyczne należy dobrać świadomie:

- Niższa alfa (np. 0,01) w systemach krytycznych ogranicza liczbę fałszywych wdrożeń, ale wymaga większych prób.

- Wyższa moc (0,9–0,95) ma sens, gdy każdy przegrany test jest kosztowny i nie chcesz przegapiać dobrych modeli.

W praktyce często kończy się na kompromisie: alfa 0,05, moc 0,8 dla większości testów, a bardziej konserwatywne ustawienia dla modeli ryzykownych (fraud, scoring kredytowy, moderacja treści).

Techniki zmniejszania wariancji w testach modeli

Jeśli ruch jest ograniczony, można skrócić test, zmniejszając wariancję metryk. Kilka technik dobrze działa przy modelach ML:

- Stratyfikacja – losowanie użytkowników do grup osobno w segmentach (np. nowi vs powracający, różne kraje). Upewniasz się, że struktura populacji jest podobna w A i B.

- CUPED (Controlled Experiments Using Pre-Experiment Data) – wykorzystanie danych sprzed testu jako kowariatu. Przykład: przychód użytkownika w tygodniu przed testem, który koryguje wariancję w trakcie testu.

- Blokowanie po czasie – analizowanie różnic dzień po dniu, a potem uśrednianie, zamiast jednej globalnej różnicy. Pomaga przy niewielkim dryfie dziennym.

Większość tych metod wymaga dobrej jakości danych historycznych i spójnych identyfikatorów użytkowników. Warto je mieć w pipeline analitycznym „na stałe”, żeby nie projektować ich od zera przy każdym teście modelu.

Projektowanie grup eksperymentalnych: randomizacja, jednostka losowania, segmenty

Implementacja randomizacji w systemach z modelami ML

Randomizacja powinna być deterministyczna i powtarzalna. Typowy wzór w usługach backendowych:

bucket = hash(user_id + experiment_id) mod 100

if bucket < 50: group = 'A'

else: group = 'B'

Taki mechanizm gwarantuje, że ten sam użytkownik zawsze trafi do tej samej grupy w danym eksperymencie, ale może trafić do innej grupy w przyszłym teście (bo zmienia się identyfikator eksperymentu). Przy modelach ML istotne jest też:

- trzymanie logów z przydziałami do grup (kto był w A/B w danym dniu),

- odporność na brak cookies / zmiany urządzeń (tam, gdzie to możliwe, losowanie po stabilnym user_id).

Multi-armed bandit vs klasyczny A/B dla modeli

Przy wielu kandydujących modelach (np. kilka wariantów rankera) kusi, by używać algorytmów typu multi-armed bandit. Ich zalety:

- szybsze kierowanie ruchu do lepszego wariantu,

- mniejsza liczba użytkowników, którzy widzą ewidentnie gorszy model.

Problem w tym, że bandity trudniej analizować klasyczną statystyką. Ruch do wariantów nie jest równy ani stały w czasie, więc proste porównanie średnich i p‑value bywa błędne. Jeśli celem jest czysta ocena jakości modelu, lepiej zostać przy klasycznym A/B, a banditów używać do eksploatacji (kiedy model jest już zaakceptowany i chodzi o maksymalizację efektu).

Eksperymenty z wieloma wariantami modeli (A/B/n)

Testy modeli ML rzadko ograniczają się do jednego kandydata. Często istnieje kilka konfiguracji:

- różne feature sety,

- różne thresholdy decyzji,

- różne wersje architektury (np. model lekki vs ciężki).

Można je testować w jednym eksperymencie A/B/n, dzieląc ruch na A, B, C, D. Trzeba wtedy zadbać o:

- kontrolę wielokrotnych porównań (np. korekta Bonferroniego, Holm–Bonferroni lub nowocześniejsze metody),

- wystarczający ruch na każdą wersję – wraz z kolejnymi wariantami maleje moc testu.

Jeśli ruch jest ograniczony, rozsądna strategia to dwustopniowe podejście:

- Krótki A/B/n z miękką metryką (CTR, engagement), żeby odsiać ewidentnie słabe modele.

- Pełnoprawny A/B na 1–2 najlepszych kandydatach z twardymi metrykami (przychód, LTV, fraud loss).

Segmentacja użytkowników: kiedy testować osobno

Modele ML często działają bardzo różnie w różnych segmentach, np.:

- nowi vs powracający użytkownicy,

- różne rynki (kraje, języki),

- różne wartości klientów (np. high‑value vs low‑value).

Naturalna pokusa to projektowanie testów osobno dla każdego segmentu. Problem to rozcieńczenie ruchu i eksplozja liczby testów, a więc i fałszywych pozytywów. Lepszy schemat:

- losować globalnie (w całej populacji),

- analizować główną metrykę globalnie,

- dodatkowo eksploracyjnie sprawdzać kilka kluczowych segmentów (np. 3–5), z podaniem szerokich przedziałów ufności.

Dopiero jeśli model ma wyraźnie negatywny efekt w jakimś dużym i kluczowym segmencie, można wprowadzić targetowane rollouty (np. nowy model tylko dla nowych użytkowników) i zaprojektować osobny test dla tego scenariusza.

Cluster randomization: kiedy użytkownicy na siebie wpływają

W systemach z efektami sieciowymi (social, marketplace, gry multiplayer) jednostką losowania nie może być pojedynczy użytkownik. Decyzje wobec jednego użytkownika wpływają na doświadczenie innych. Przykłady:

- feed treści: zachowanie jednego użytkownika wpływa na widoczność postów innych,

- aukcje reklam: nowy model licytacji w B wpływa na clearing price w A.

W takich scenariuszach stosuje się randomizację klastrową. Losuje się całe klastry (np. grupy znajomych, regiony, serwery, publisher IDs) do A lub B. Skutki:

- mniejsza efektywna liczba jednostek (bo jednostką jest klaster, nie użytkownik),

- większa wariancja, konieczność większych prób.

Za to lepiej zachowane są założenia o braku spilloverów między grupami, a wnioski statystyczne stają się sensowne. To często jedyna obrona przed „zarażaniem” wyników pomiędzy wariantami modelu.

Analiza statystyczna wyników testu A/B modeli

Dobór testu statystycznego do metryki

Metryki w testach modeli są często:

- silnie skośne (przychód per user, LTV),

- z wieloma zerami (konwersja),

- ograniczone do [0,1] (CTR per user).

Prosty t‑test dla różnicy średnich nie zawsze jest idealny, ale bywa wystarczający przy dużych próbach, dzięki centralnemu twierdzeniu granicznemu. W praktyce przydają się trzy podejścia:

- t‑test z normalnym przybliżeniem – prosty, dobrze wspierany, dobry dla dużych metryk per user.

- Test proporcji – dla czystych wskaźników typu „czy użytkownik kupił” (tak/nie).

Resampling i bootstrap przy metrykach „brudnych” i ciężkoogonowych

Przy metrykach typu przychód per user, LTV czy liczba eventów na użytkownika rozkład bywa daleki od normalnego. Kilku „wielorybów” z gigantycznym przychodem potrafi przesunąć średnią i rozwalić klasyczne założenia testów parametrycznych. Zamiast gimnastykować się transformacjami logarytmicznymi, często lepiej użyć podejść opartych na resamplingu.

Dwa proste i skuteczne narzędzia:

- bootstrap dla różnicy średnich/median – losujesz z powtórzeniami użytkowników z grupy A i B, liczysz różnicę metryk, powtarzasz tysiące razy; z rozkładu różnic wyznaczasz przedział ufności,

- permutacyjny test istotności – mieszasz etykiety A/B między użytkownikami, zakładając brak efektu modelu; patrzysz, jak często „losowa” różnica jest większa niż ta obserwowana.

Bootstrap dobrze sprawdza się, gdy chcesz ocenić wielkość efektu (przedziały ufności na różnicy), a test permutacyjny – gdy priorytetem jest p‑value bez silnych założeń o rozkładzie. W obu przypadkach jednostką próbkowania powinien być użytkownik (nie pojedyncze requesty), żeby nie zawyżać sztucznie liczebności prób.

Bayesowskie porównanie modeli zamiast klasycznego p‑value

W testach modeli ML sensowne jest też podejście bayesowskie. Zamiast pytać „czy różnica jest statystycznie istotna”, zadajesz pytanie: „jakie jest prawdopodobieństwo, że model B jest lepszy od A o co najmniej X%?”. Taki język lepiej pasuje do decyzji produktowych.

Przykładowy workflow przy metryce typu konwersja (0/1 per user):

- przyjmujesz rozkład Beta jako prior dla współczynnika konwersji w A i B (np. Beta(1,1) – jednolity),

- aktualizujesz priory danymi z testu, dostając posteriory Beta(α,β) dla każdej grupy,

- samplujesz z posteriorów i liczysz odsetek próbek, w których konwersja B > konwersja A + minimalny efekt (np. +1%).

Tak dostajesz liczby typu: „z prawdopodobieństwem 93% model B podnosi konwersję o co najmniej 1% względem A”. Dla biznesu to dużo czytelniejszy komunikat niż „p = 0,047”. Minusem jest konieczność świadomego wyboru priory (przy małych próbach ma to znaczenie), ale w testach z dużym ruchem priory praktycznie „znikają” w danych.

Wielokrotne testowanie i „p‑hacking” przy wielu eksperymentach

W pipeline’ach ML łatwo uruchamiać dziesiątki wariantów modeli i eksperymentów. Problem: im więcej hipotez testujesz, tym wyższe ryzyko fałszywych pozytywów. Kilka typowych źródeł „p‑hackingu”:

- odpalenie 10 testów A/B równolegle i opowiedzenie historii tylko o jednym, który „wyszedł”,

- dokładanie kolejnych metryk wtórnych po zobaczeniu wyników („a może jeszcze spojrzymy na engagement u użytkowników z Niemiec?”),

- przerywanie testu w momencie, gdy p‑value przypadkiem spadnie poniżej progu.

Minimalne zabezpieczenia przed takim rozmyciem wniosków:

- pre‑registracja planu – nawet w prostym dokumencie: główna metryka, czas trwania, próg efektu minimalnego; bez tego każda analiza jest potencjalnie „dopasowana do wyniku”,

- kontrola FDR/FWER – jeśli porównujesz wiele wariantów czy segmentów, jawnie zastosuj korektę (Holm–Bonferroni, Benjamini–Hochberg),

- raportowanie wszystkich wyników, także „negatywnych” – wewnętrznie, choćby w skróconej formie; uczy to zespół skalibrowanego myślenia o eksperymentach.

Sequential testing i ciągły monitoring wyników

Modele ML często chce się „podglądać” w trakcie testu: dashboard ze świeżymi metrykami, codzienne sync‑i, presja na szybkie decyzje. Klasyczny test z ustaloną z góry próbą zakłada jeden odczyt na koniec. Gdy zaglądasz w wyniki codziennie i przestajesz test, gdy p‑value spadnie poniżej 0,05, realna alfa rośnie wielokrotnie.

Bezpieczniejszą alternatywą jest sequential testing – metody, które formalnie dopuszczają wielokrotne „podglądanie” danych. Przykłady:

- testy grupowe (group sequential) z zaplanowanymi „interim looks” – np. 3–4 punkty w trakcie testu, z korektą progów zatrzymania,

- SPRT (Sequential Probability Ratio Test) w prostszych przypadkach,

- bayesowskie reguły zatrzymania („kończymy, gdy P(B > A o ≥ X%) > 0,95 albo < 0,05”).

Jeśli nie chcesz wdrażać od razu pełnego sequential testingu, minimum to:

- zdefiniować sztywny minimalny czas trwania (np. co najmniej pełny tydzień) i nie przerywać testu wcześniej,

- analizować w trakcie tylko stabilność metryk (czy nic się nie psuje drastycznie), bez formalnego ogłaszania zwycięzcy.

Efekt sezonowości i kampanii zewnętrznych

Modele uczone na danych „zwykłych dni” mogą zachowywać się inaczej w trakcie sezonów (Black Friday, święta, duża kampania TV). Jeśli w połowie testu wchodzi kampania marketingowa, zmienia się mix użytkowników: więcej nowych, inna intencja zakupowa, inne zachowania.

Kilka zasad, które redukują bałagan:

- oznaczaj okresy specjalne w danych (flagą w tabelach z eventami),

- analizuj metryki osobno dla „zwykłych dni” i „dni kampanijnych” – przynajmniej eksploracyjnie,

- jeśli kampania zajmuje większą część testu i jest nienaturalna dla przyszłości, rozważ powtórzenie eksperymentu po niej,

- w antyfraudzie i pricingu reklam miej przygotowane metryki odporniejsze na wahania wolumenu (np. fraud rate per segment zamiast absolutnej liczby fraudów).

Interpretacja przedziałów ufności i wielkości efektu

W decyzjach o wdrożeniu modelu sama informacja „istotne / nieistotne” jest mało przydatna. Kluczowe jest połączenie wielkości efektu (effect size) z niepewnością pomiaru.

Dobrą praktyką jest raportowanie dla głównej metryki:

- szacowanej różnicy (np. +2,3% CTR względnie do A),

- 95% przedziału ufności dla tej różnicy,

- przeliczenia różnicy na biznesowy wpływ (np. dodatkowy przychód miesięcznie przy obecnym ruchu).

Jeżeli przedział jest szeroki i obejmuje zarówno sensowny zysk, jak i bolesną stratę, lepiej test przedłużyć lub powtórzyć niż uspokajać się samym faktem, że p‑value wyszło powyżej 0,05. Jeśli przedział jest wąski i blisko zera (np. -0,2% do +0,3%), masz mocny argument, że różnice są biznesowo nieistotne, nawet jeśli formalnie „p > 0,05”. To szczególnie przydatne przy testach regresji do prostszego, tańszego modelu.

Łączenie wielu metryk: kompozyty i hierarchia celów

Rzadko zdarza się, że model optymalizuje pojedynczą metrykę bez kompromisów. Nowy ranker może zwiększać CTR, ale jednocześnie psuć retencję lub podbijać koszty infrastruktury. Analiza powinna odzwierciedlać taką strukturę celów.

Pomagają dwa podejścia:

- hierarchia metryk – definiujesz główną metrykę decyzyjną (np. przychód per user) i zbiór „guardrail metrics” (np. czas ładowania, liczba ticketów do supportu, churn). Decyzję opierasz głównie na pierwszej, ale warunkowo („wdrażamy, jeśli guardraile nie spadły poniżej X”).

- metryki kompozytowe – łączysz kilka aspektów w jedną liczbę, np. przychód skorygowany o koszt inferencji modelu albo NPS ważony przychodem użytkownika.

Przy kompozytach łatwo stracić intuicyjność, więc przy analizie warto pokazać też komponenty składowe. Przykład: nowy model polecania podnosi przychód o 3%, ale koszt GPU rośnie o 50%. Kompozyt „zysk netto per user” może być stabilny, ale zespół infrastruktury może mieć inne zdanie. Dobrze to jasno pokazać w tabeli wyników, a nie tylko w jednej złożonej liczbie.

Stabilność modelu w czasie: dryf danych w trakcie testu

Przy dłuższych testach (kilka tygodni i więcej) zmienia się nie tylko sezonowość, ale też same dane wejściowe do modelu: inne distribution feature’ów, inne typy użytkowników, nowe kampanie marketingowe, czasem zmiany w logice aplikacji wpływające na eventy.

Żeby analiza nie była prowadzeniem średniej po zupełnie różnych światach, dobrze jest:

- monitorować metryki wejściowe (feature drift) w A i B – czy rozkład kluczowych cech użytkowników/requestów nie rozjeżdża się między grupami,

- sprawdzać efekt modelu w oknach kroczących (np. 3‑dniowych lub tygodniowych) i patrzeć, czy sygnał jest spójny w czasie,

- w analizie końcowej rozdzielić ewentualne fazy, jeśli zaszły w ich trakcie istotne zmiany produktu czy ruchu.

Jeśli widzisz wyraźne „wypłukiwanie” efektu w czasie (np. duży wzrost CTR w pierwszym tygodniu, który zanika w kolejnych), lepiej potrakować test jako sygnał, że model wymaga mechanizmu ciągłego dostrajania albo osobnych polityk rolloutowych (np. tylko dla nowych użytkowników).

Replikacja i walidacja wyników na kolejnych kohortach

Jednorazowy test, nawet dobrze zaprojektowany, może trafić na wyjątkowy okres lub specyficzny miks użytkowników. Przy modelach, które mają duży wpływ na biznes lub ryzyko regulacyjne, rozsądne jest wprowadzenie etapu potwierdzenia wyniku.

Praktyczne schematy:

- re‑test na nowej kohorcie – powtórzenie eksperymentu po pewnym czasie (np. miesiącu) z tym samym designem, ale na innych użytkownikach; szczególnie użyteczne, gdy pierwszy test był „na granicy” istotności,

- rollout stopniowany jako eksperyment – zamiast od razu 100% ruchu, przechodzisz przez progi (np. 10% → 30% → 70% → 100%), na każdym poziomie monitorując te same metryki co w teście,

- eksperymenty shadow / silent – nowy model działa równolegle do starego, nie wpływając na użytkownika, ale logujesz jego decyzje i hipotetyczne metryki (np. co by się stało z aukcją). To nie jest pełnoprawny test A/B, ale dobry sanity‑check przed prawdziwym eksperymentem.

Organizacja procesu: jak nie zgubić wyników w chaosie eksperymentów

Gdy zespół ML ma już kulturę testowania, pojawia się inny problem: eksperymentów jest dużo, dokumentacji mało, wyniki giną w Slacku i w dashboardach. Kolejne osoby próbują podobnych pomysłów, nie wiedząc, że coś było już testowane pół roku temu.

Pomaga kilka prostych nawyków procesowych:

- centralny rejestr eksperymentów – np. jedna tabela lub prosty system, w którym każdy test ma ID, opis hipotezy, kluczowe parametry (metryki, czas trwania, ruch), wynik i link do raportu,

- szablon raportu – 1–2 strony z: opisem wariantu modelu, główną metryką, efektami (z przedziałami ufności), głównymi guardrailami, wnioskami i rekomendacją,

- twarde powiązanie kodu z ID eksperymentu – feature flag, nazwa konfiguracji modelu, tag w systemie deploymentu; dzięki temu za pół roku można prześledzić, który eksperyment doprowadził do konkretnej zmiany w produkcji.

Przy modelach krytycznych (fraud, scoring kredytowy, moderation) taka dokumentacja jest też często wymagana przez compliance i audyty. Łatwiej wtedy pokazać, że decyzje o wdrożeniach były oparte na rzetelnych eksperymentach, a nie na intuicji pojedynczej osoby.

Najczęściej zadawane pytania (FAQ)

Po co robić testy A/B modeli ML, skoro mam dobre wyniki na walidacji offline?

Walidacja offline mówi, jak model radzi sobie na danych historycznych według metryk typu AUC, logloss czy NDCG. Nie pokazuje natomiast, jak ten model przełoży się na pieniądze, zachowanie użytkowników, churn czy obciążenie supportu po wdrożeniu.

Model może mieć świetny AUC, a jednocześnie obniżać przychód lub konwersję, bo zmienia strukturę oferty, częstotliwość kontaktu czy ryzyko błędnych decyzji. Test A/B sprawdza realny efekt biznesowy online, z wszystkimi konsekwencjami progu decyzyjnego, logiki rekomendacji i reguł biznesowych.

Kiedy wystarczy walidacja offline, a kiedy konieczny jest test A/B na produkcji?

Walidacja offline zwykle wystarcza dla modeli pomocniczych i back-office, np. automatyczne tagowanie ticketów, kategoryzacja dokumentów, wewnętrzne priorytety zadań. Wpływ na klienta jest tam pośredni i niewielki, więc nie ma sensu komplikować procesu eksperymentem online.

Test A/B staje się niezbędny, gdy model bezpośrednio zmienia zachowanie użytkowników: rekomendacje, rankingi, personalizacja, kampanie marketingowe. Jeśli decyzja może istotnie zmienić przychód, CTR, churn czy LTV i dotyczy dużej części ruchu, jedynie eksperyment na produkcji da wiarygodną odpowiedź, czy nowy model rzeczywiście pomaga biznesowi.

Jakie decyzje w systemach ML najbardziej opłaca się testować A/B?

W praktyce testuje się nie tylko zmianę modelu, ale cały „pakiet decyzyjny” wokół niego. Największy zwrot dają testy:

- nowej wersji modelu (inna architektura, algorytm, hiperparametry),

- nowych feature’ów (np. sygnały behawioralne, agregaty czasowe, dane z innych systemów),

- progu decyzji (threshold dla fraudu, wysyłki powiadomień, ofert kredytowych),

- polityki rekomendacji (więcej nowości vs bestsellery, poziom personalizacji, dywersyfikacja listy),

- sposobu prezentacji wyniku modelu (kolejność, liczba elementów, dodatkowe informacje przy decyzji).

Każda z tych zmian może poprawić metryki offline, a jednocześnie zaszkodzić: przychodowi, satysfakcji użytkownika, kosztom operacyjnym czy marży. Test A/B pozwala zmierzyć ich pełny efekt, a nie tylko zmianę AUC czy logloss.

Jak poprawnie losować użytkowników do testu A/B modelu ML: user, sesja czy request?

Domyślnym, bezpiecznym wyborem jest losowanie na poziomie użytkownika (user-level). Ten sam użytkownik cały czas trafia do tej samej grupy, więc ma spójne doświadczenie, a metryki „per user” (np. konwersja, przychód na użytkownika) są łatwe do interpretacji.

Losowanie na poziomie sesji lub requestu warto rozważać tylko w specyficznych przypadkach: krótkie, niezależne sesje, bardzo niski poziom zaangażowania, potrzeba maksymalnego wykorzystania ruchu. Te podejścia generują jednak więcej korelacji i komplikują analizę statystyczną, więc wymagają większego doświadczenia eksperymentatorskiego.

Jakie są najczęstsze pułapki statystyczne w testach A/B modeli ML?

Przy modelach ML często łamiemy klasyczne założenia testów A/B: niezależność próbek, stacjonarność oraz brak efektów spillover. Przykład: rekomendacje zmieniają popularność produktów, co wpływa na zachowanie innych użytkowników i sam rozkład danych w trakcie testu.

Do typowych pułapek należą też: zbyt częzne „podglądanie” wyników i przerywanie testu, gdy „wygląda na wygranego”, ignorowanie korelacji pomiędzy requestami tego samego użytkownika, mieszanie efektu modelu z efektem zmienionej prezentacji UI. Dobry eksperyment ML musi być zaprojektowany tak, by te efekty ograniczyć, a przynajmniej świadomie je uwzględnić w interpretacji.

Dlaczego model o wyższym AUC może mieć gorszą konwersję lub przychód?

AUC i podobne metryki mierzą, jak dobrze model sortuje przypadki według „prawdopodobieństwa pozytywu” na danych historycznych. Nie uwzględniają jednak kontekstu biznesowego: efektu zawężenia oferty, wpływu na cross-sell, poczucia wyboru, zmęczenia komunikacją czy kosztu błędów.

Typowa sytuacja: nowy model rekomendacji mocno zawęża listę do produktów bardzo podobnych do tych, które użytkownik kupował wcześniej. AUC rośnie, bo trafność rośnie. Jednocześnie spada średni koszyk, bo użytkownik rzadziej widzi produkty komplementarne i szybciej rezygnuje z zakupu. Taki efekt da się wychwycić tylko w eksperymencie online, opartym o konwersję i przychód, a nie wyłącznie o metryki predykcyjne.